ComfyUI

13/11/2025

eeenajenaciones

Acceso a ComfyUI Colab

Primeros pasos

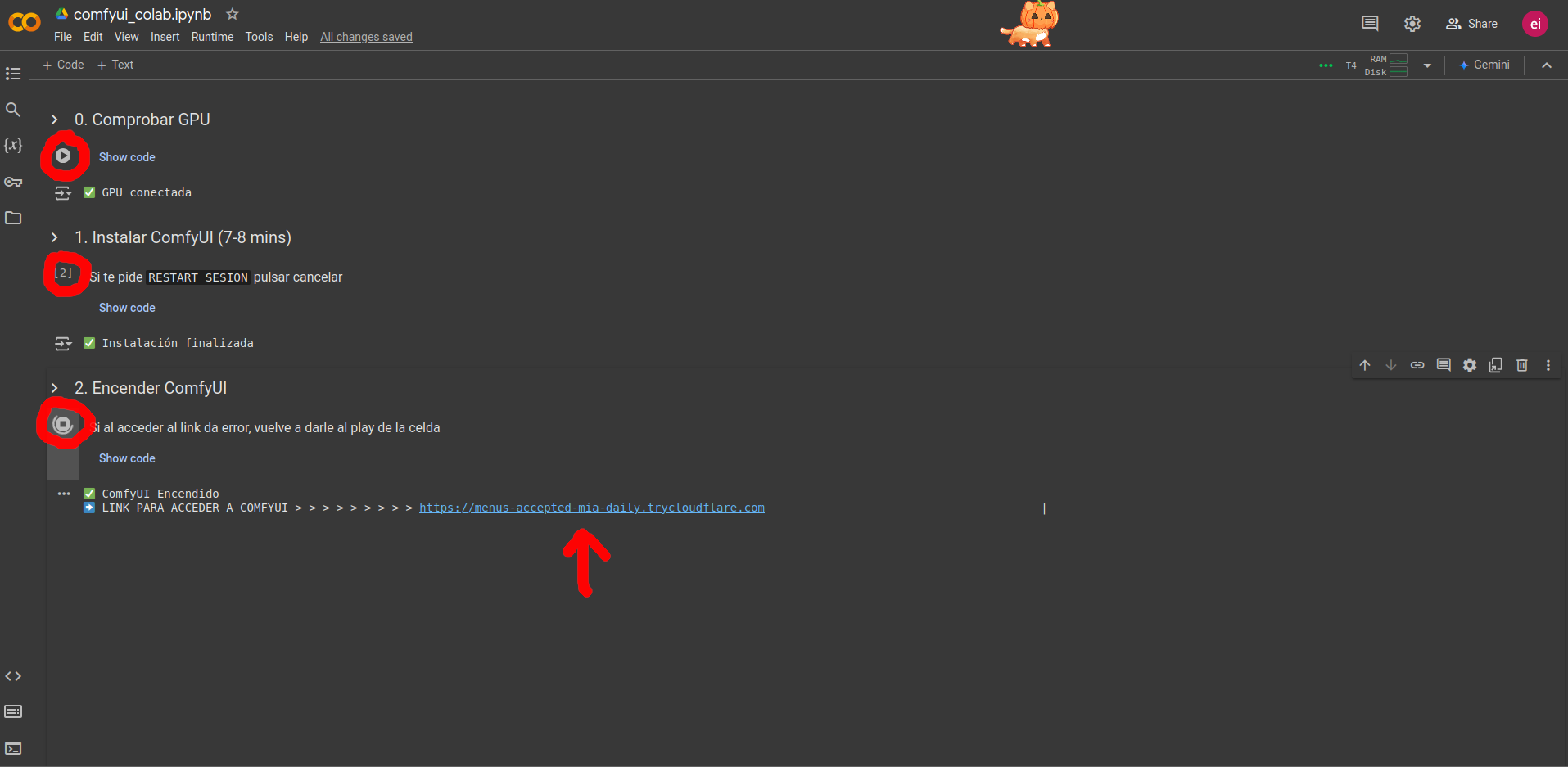

Encender ComfyUI

Para

acceder al ComfyUI es necesario dar paso por paso a los botones de play

▶️ de cada celda (los botones aparecen cuando pasas el cursor por

encima de la celda).

Si las tres celdas dan una respuesta positiva ✅ podrás acceder al link que te redirigirá a ComfyUI.

Puede

pasar que en la última celda no funcione correctamente el link. Es

normal. Dale al botón de stop ⏹️ y de nuevo al play ▶️ de esa celda

para reiniciarla.

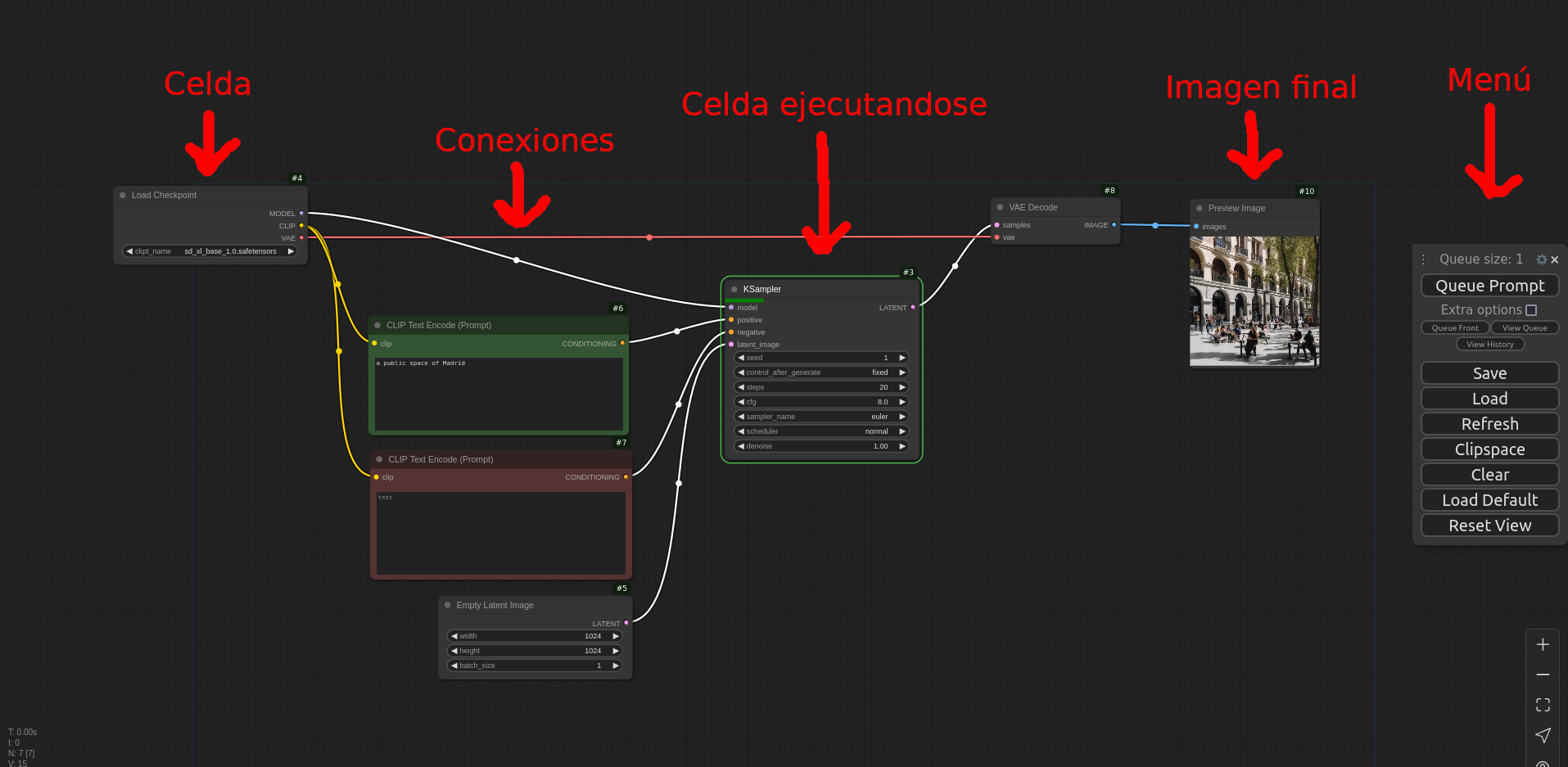

Interfaz

Comandos útiles:

Ctrl + c: copiar

Ctrl + v: pegar sin conexiones

Ctrl + Shift + v: pegar con conexiones

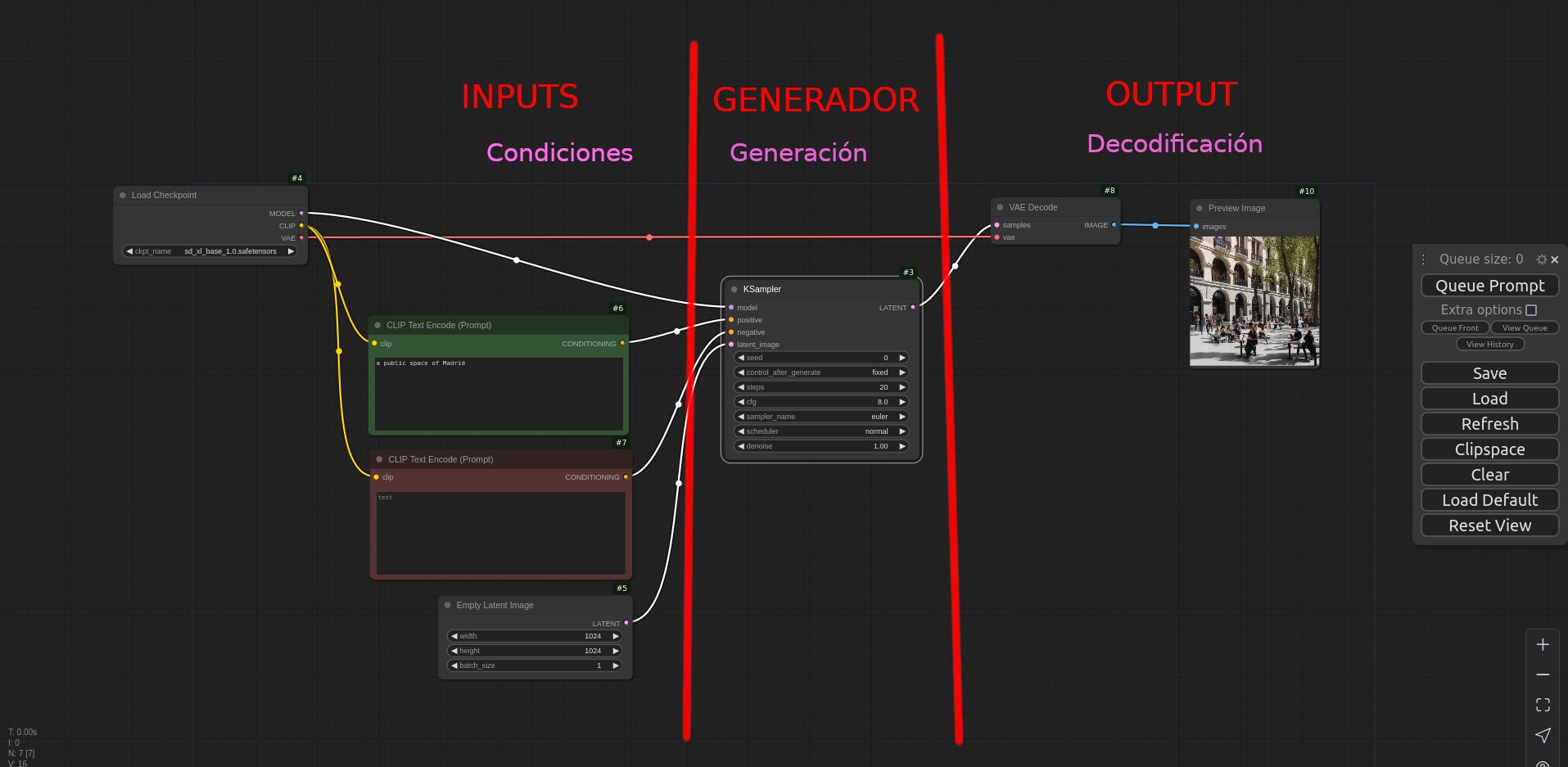

Texto a imagen

| Para abrir la receta arrastra esta imagen a la pantalla de ComfyUI |

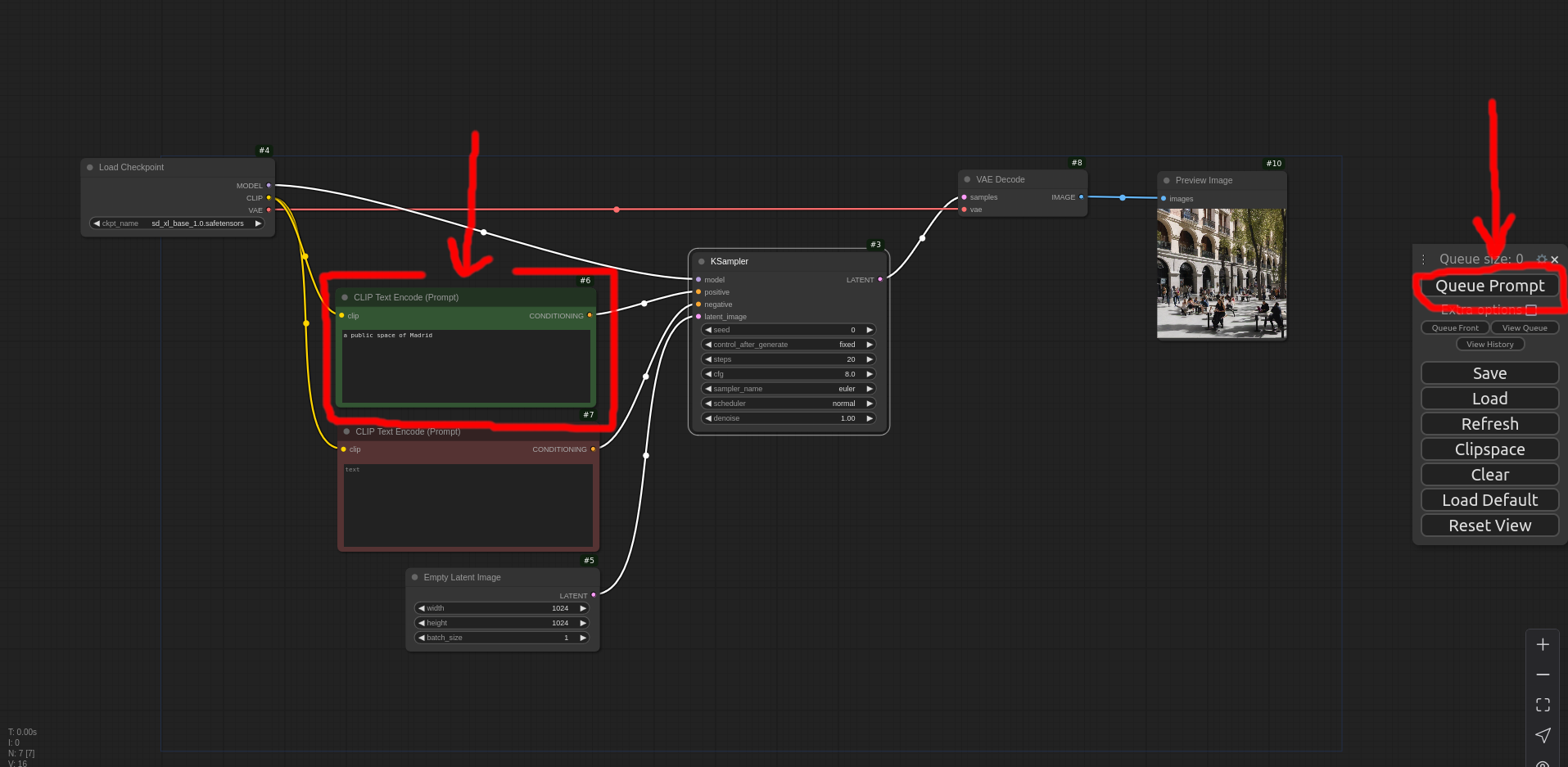

Para generar una imagen añade un texto en la celda verde CLIP TEXT ENCODE y pulsa QUEUE PROMPT

Parámetros

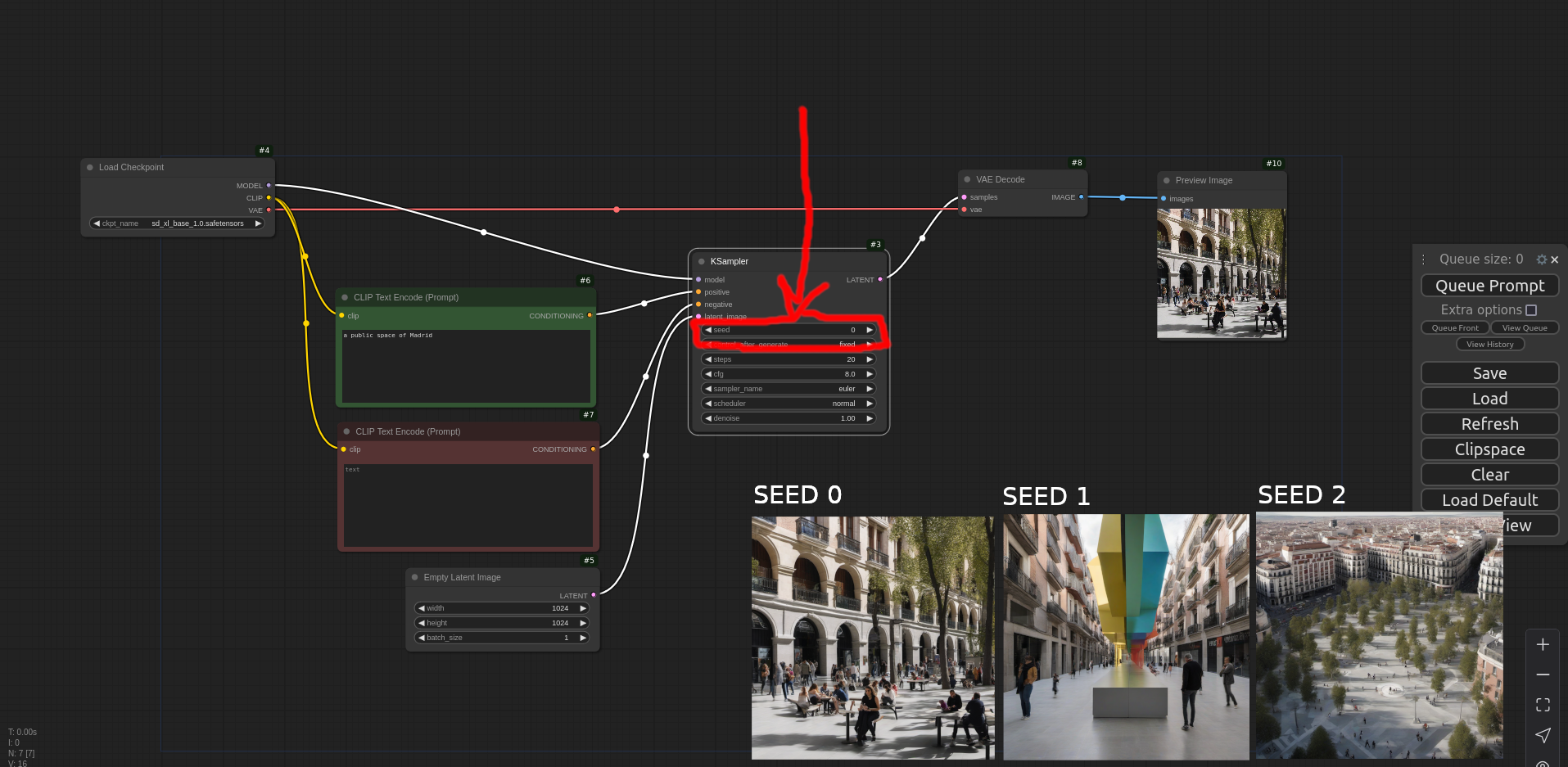

Seed

Prueba

sin cambiar la frase a modificar el seed. Cada seed es un punto de

partida. Con cada seed se genera una imagen distinta pero que todas

responden a la descripción textual.

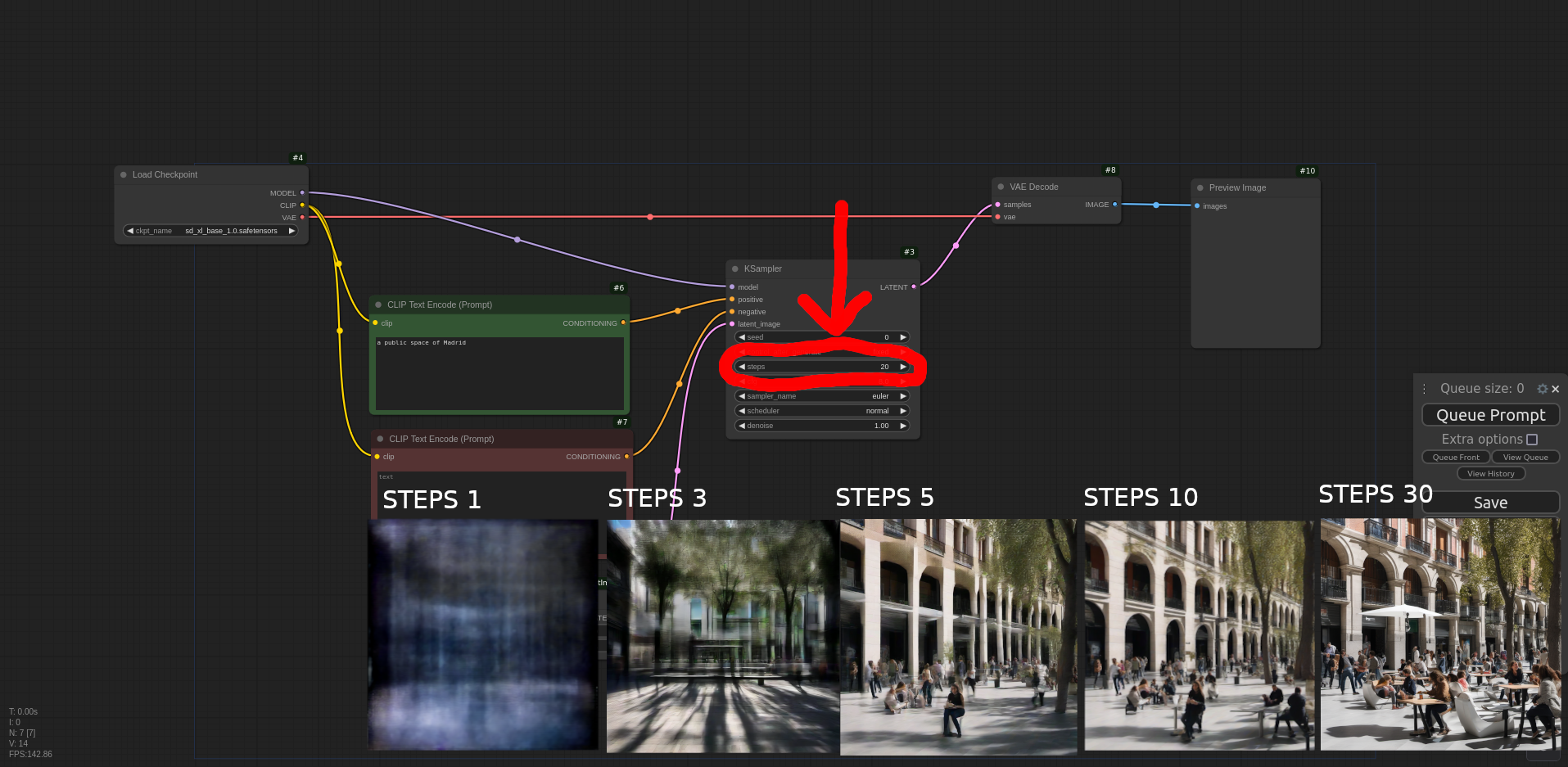

Steps

Los

steps o pasos indican la cantidad de veces que se ejecute el mecanismo

de difusión. De normal necesita unos 20 pasos mas o menos, a partir de

ahí puede mejorar pero llega un punto que se estanca y deja de mejorar.

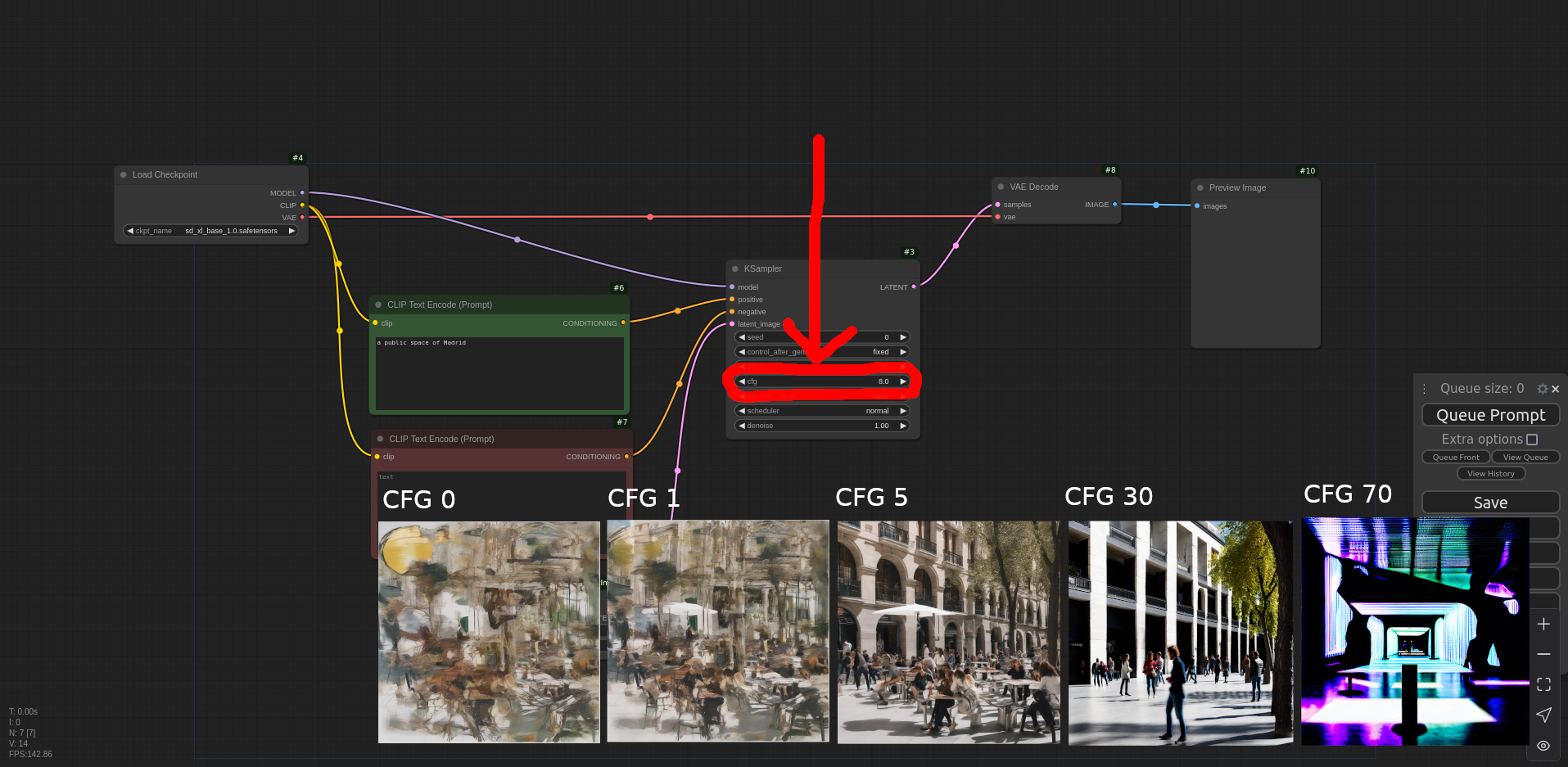

CFG

Classifier-Free Guidance o CFG indica la fuerza con la condiciona el texto

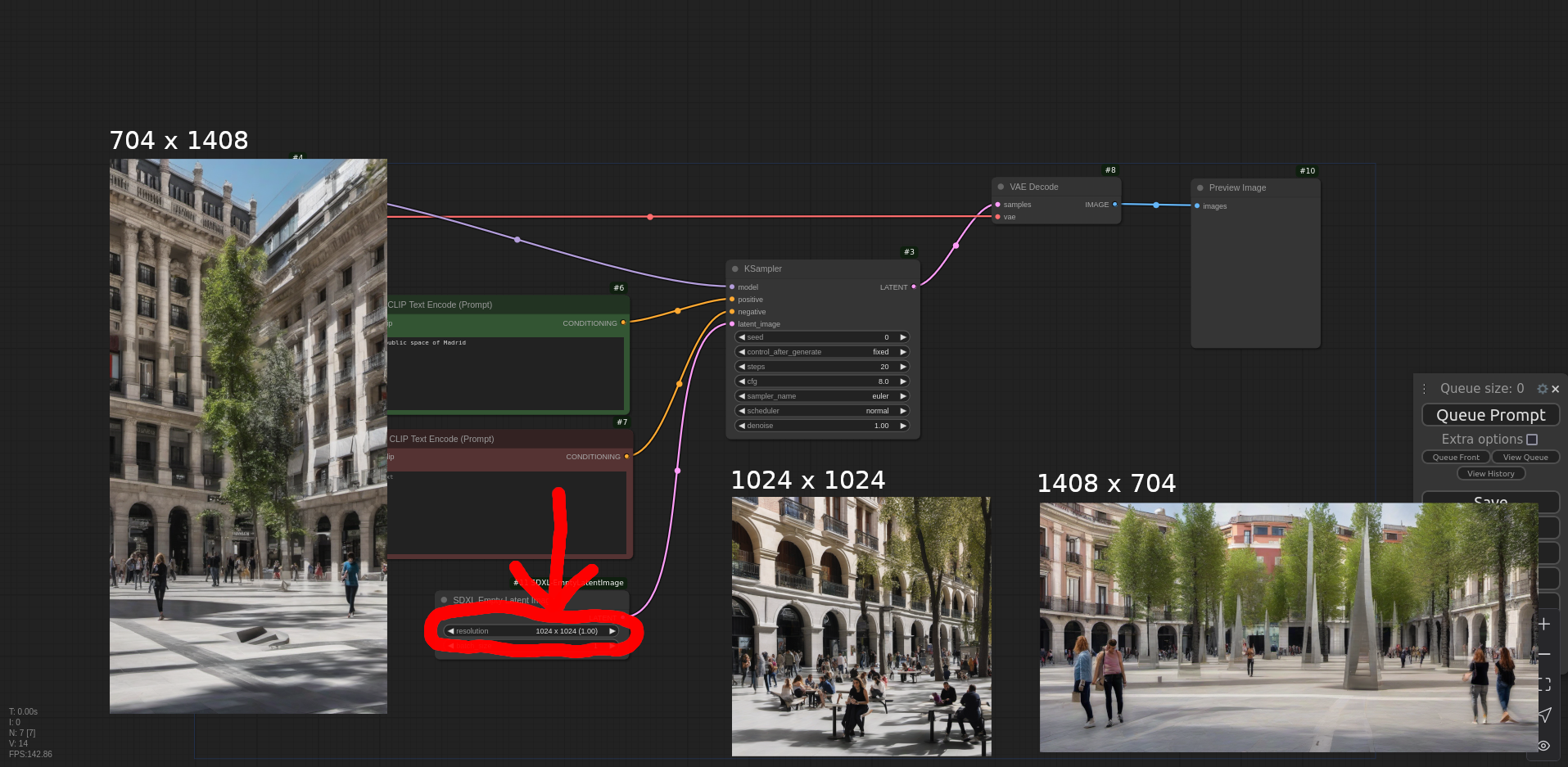

Resolución

El tamaño de la imagen también condiciona el contenido.

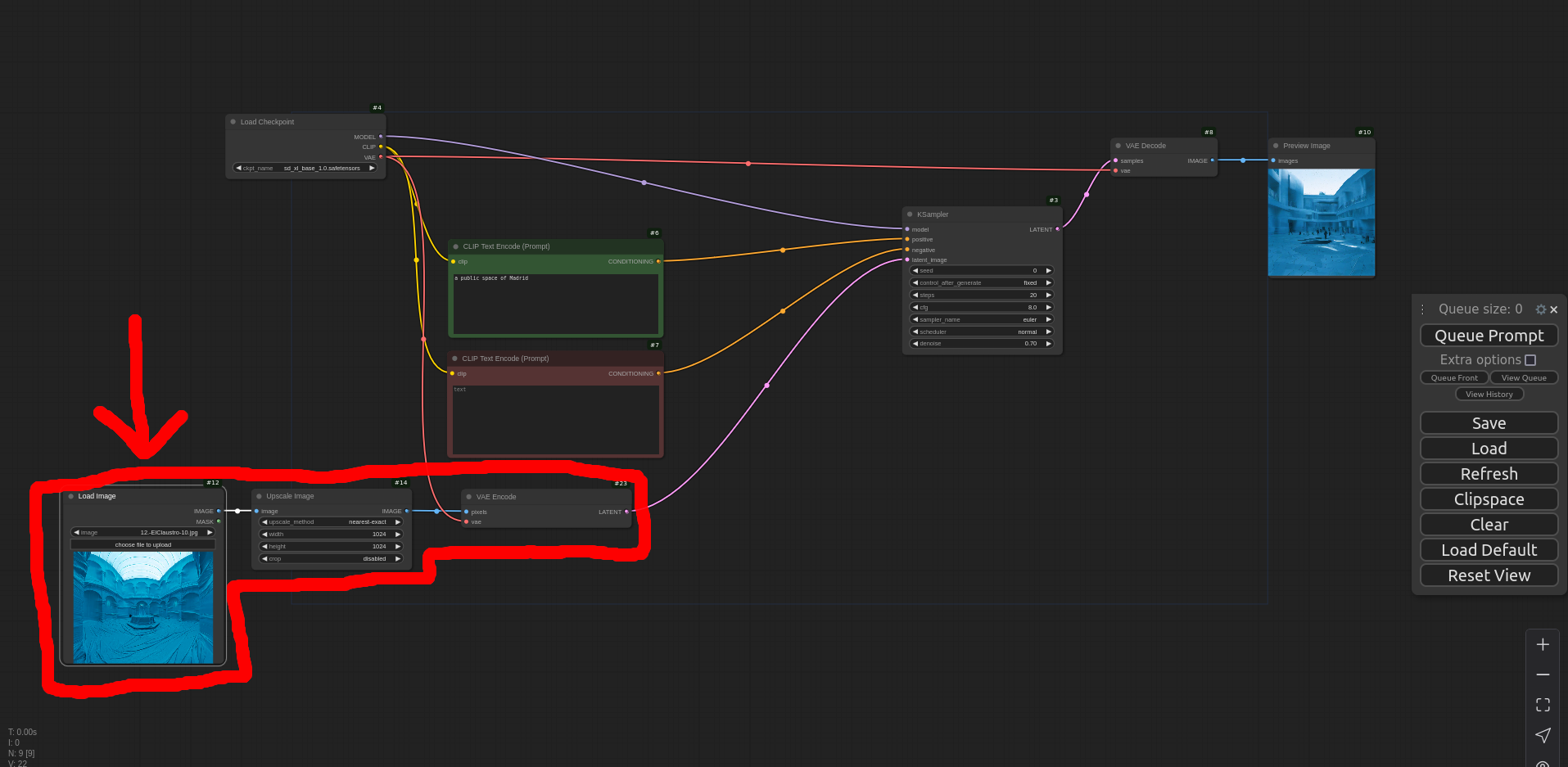

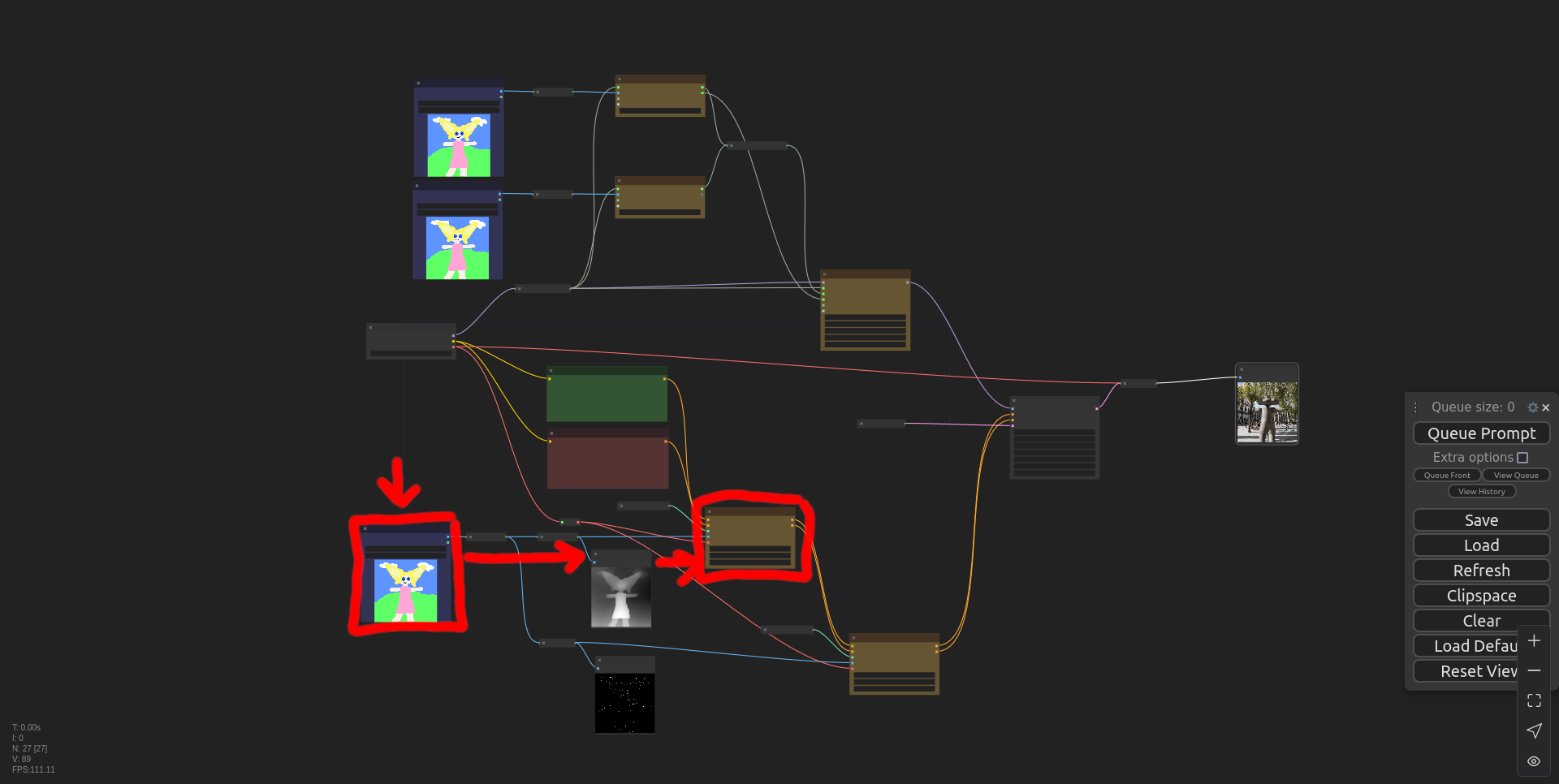

Imagen a imagen + texto

|

| Para abrir la receta arrastra esta imagen a la pantalla de ComfyUI |

Para

transformar una imagen usando SD hay que sustituir la celda de EMPTY

LATENT IMAGE por una seríe de celdas que codifican la imagen.

Parámetros

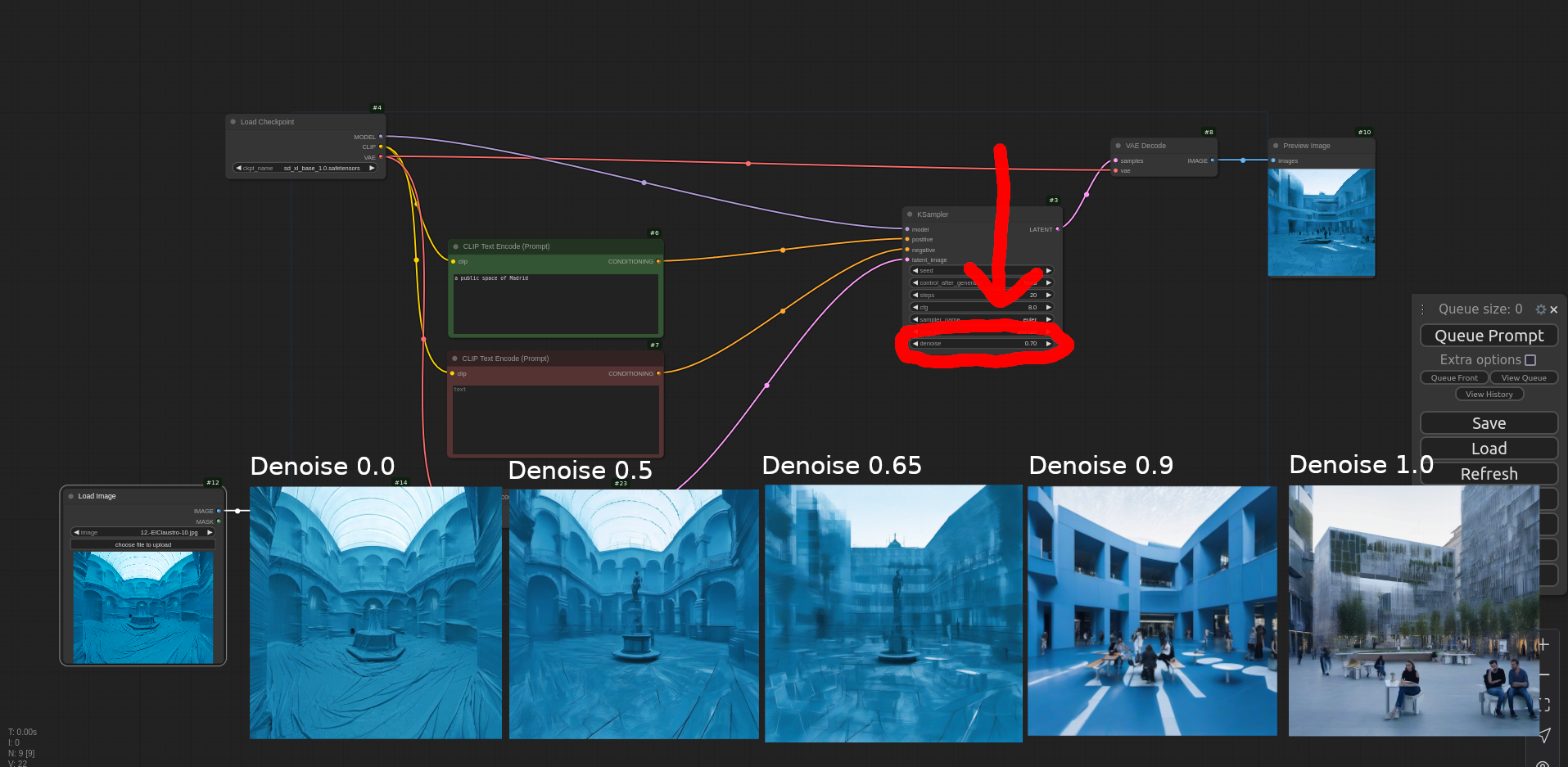

Denoise

El

parametro denoise indica cuánto ruido se le añade a la imagen. Cuanto

más ruido se le añada más desaparece la imagen original.

Imagen original de https://www.peniqueproductions.com/

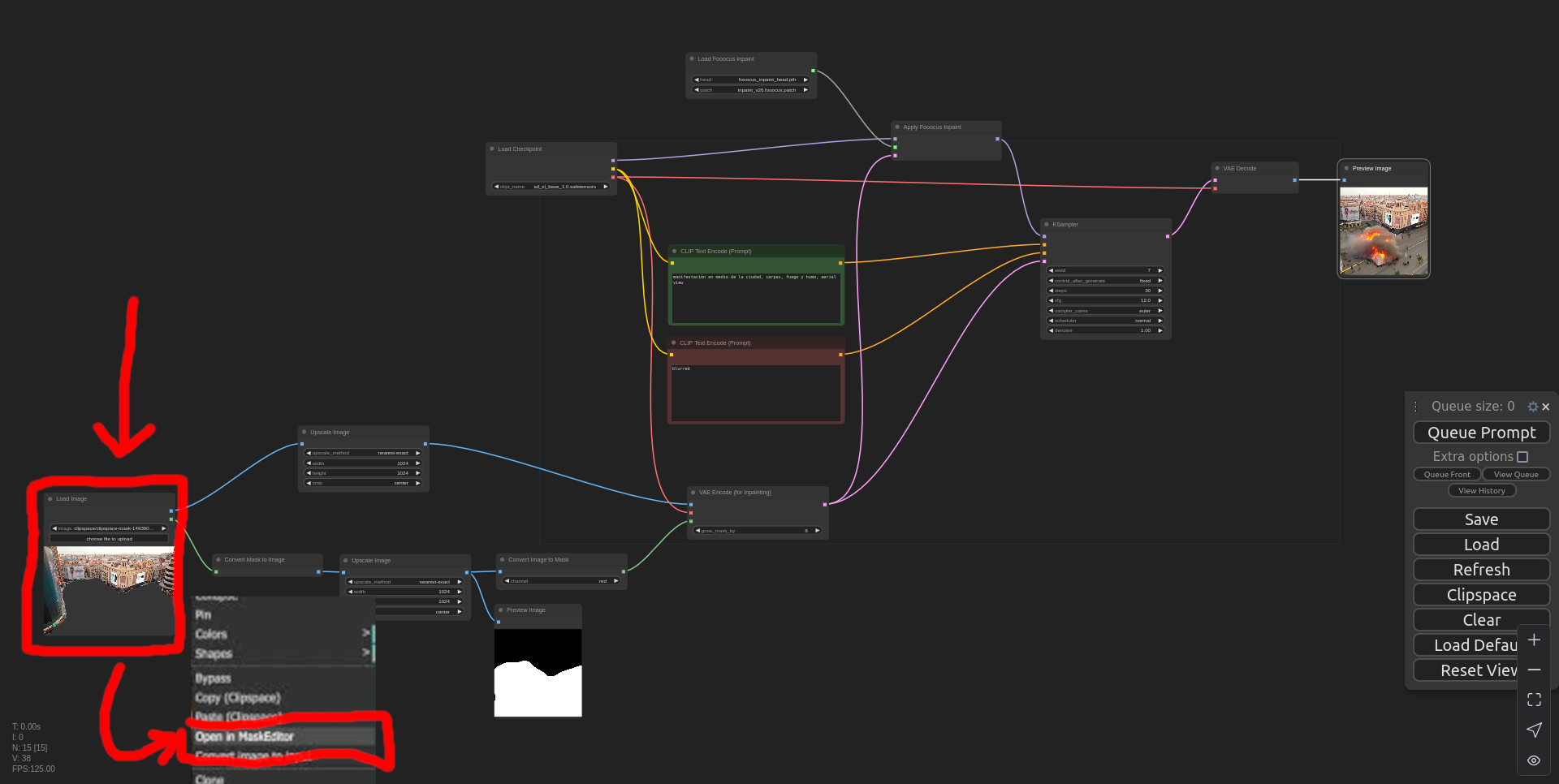

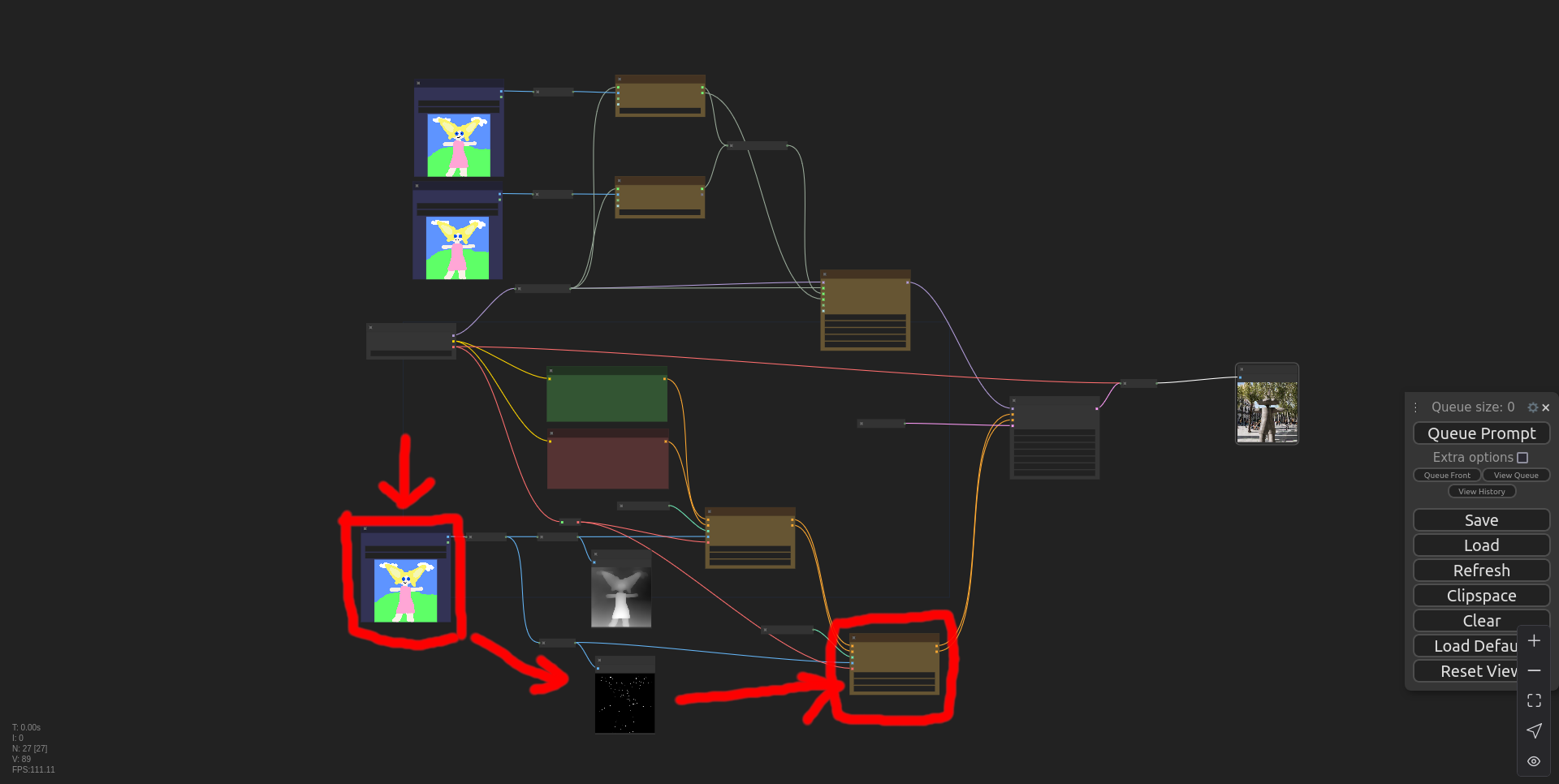

Inpainting

|

| Para abrir la receta arrastra esta imagen a la pantalla de ComfyUI |

Para regenerar una parte de la imagen carga una imagen de base y pulsando botón derecho sobre ella, selecciona el maskeditor. Elimina la parte que quieras reconstruir y añade un texto con la descripción.

Condiciones no textuales

La

generación de la imagen puede ser condicionada no solo por texto si no

que hay muchas más maneras. Usando los algoritmos ControlNet e IPAdapter

se pueden usar otras imágenes como condición.

Profundidad (ControlNet)

Introduce una imagen y se generará un mapa de profundidad. En la casilla amarilla podrás controlar la fuerza de la condición y el periodo durante el cuál se aplica.

Bordes (ControlNet)

Similar a la profundidad.

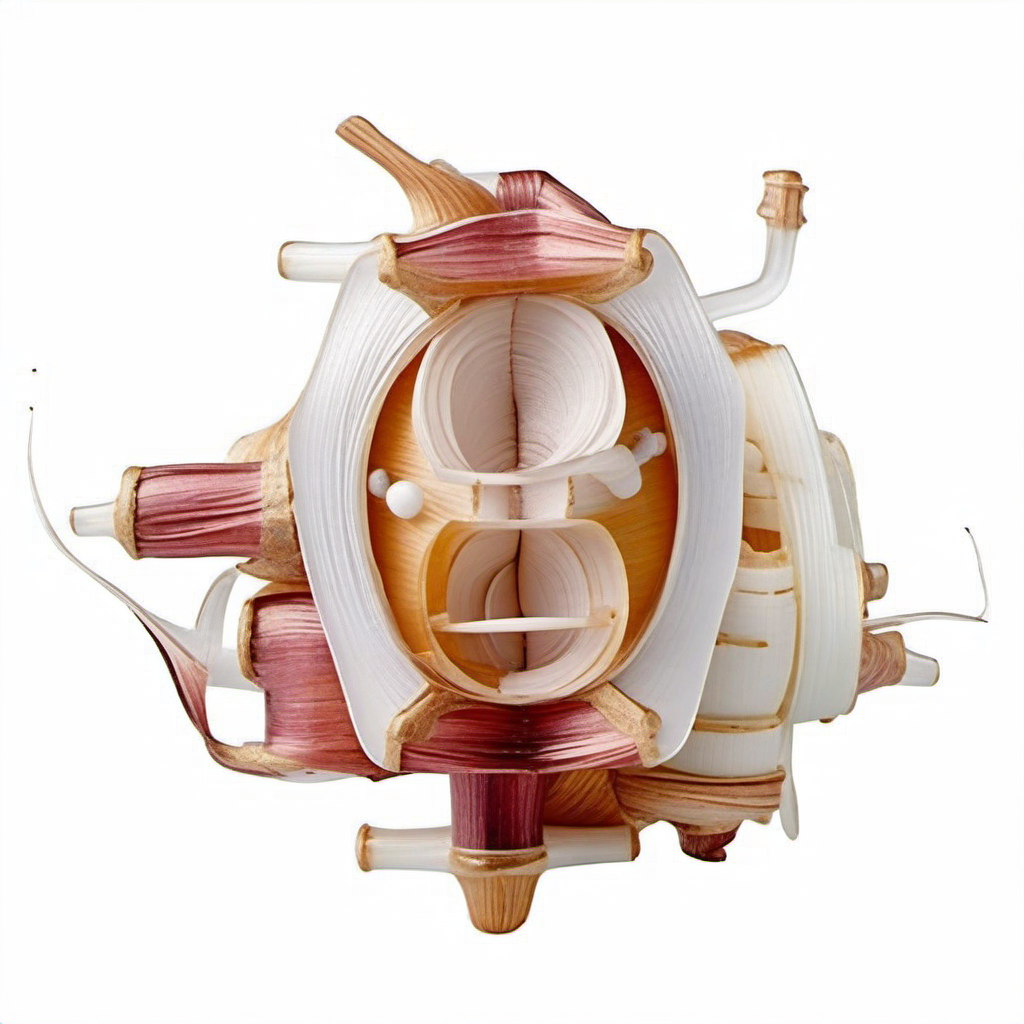

Referencia visual (IPApadater)

Este es parecido a los anteriores pero en vez de condicionar desde el algoritmo de CLIP trabaja desde el modelo. en este caso tratará de influenciar la generación de la imagen final. Puede incluirse tantas imágenes como se quiera y modificar el peso y su duración.